“Kendi Kendine Terapi” Riskleri Nelerdir?

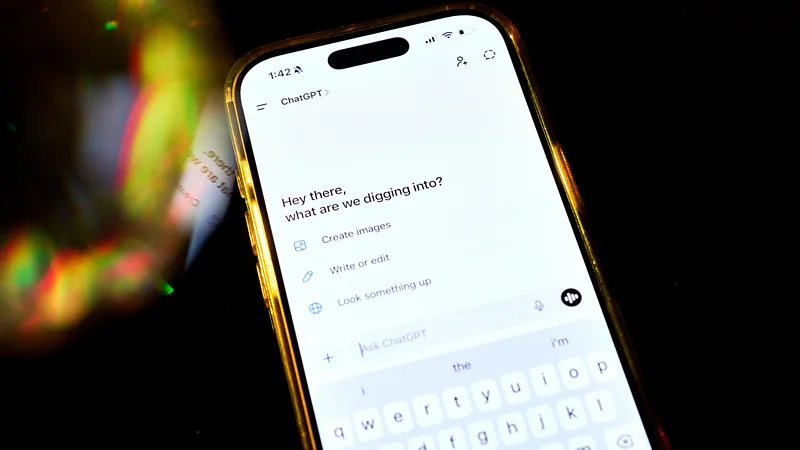

Le Monde'da yayımlanan bilimsel bir araştırmada, yapay zekâ (YZ) tabanlı sohbet robotlarının (chatbot) ruh sağlığı alanında kullanımının hızla yayılmasıyla ortaya çıkan fırsatları ve ciddi riskleri analiz edildi.

Özellikle gençler ve kırılgan kullanıcılar arasında ChatGPT gibi araçlara duyulan güvenin büyümesi, profesyonel destek yerine bu teknolojilere yönelim olarak görülüyor.

Bu gelişme bilim insanlarını, psikiyatri uzmanlarını ve sağlık otoritelerini alarm durumuna geçiriyor.

Neden Bu Konu Önemli?

Dünyada onlarca milyon kişi, özellikle gençler, duygusal sıkıntı ve psikolojik sorunlarını ChatGPT ve benzeri robotlarla paylaşıyor.

Bazı mahkeme süreçlerinde, bu tarz chatbot’ların kullanıcılar üzerinde delişkân düşünceleri tetiklediği veya intihara yardım etmiş olabileceği iddialarıyla yasal adımlar gündeme geldi.

OpenAI ve diğer şirketler “ChatGPT Health” gibi daha kişiselleştirilmiş yanıt verebilecek yeni ürünler duyursa bile, bu sistemlerin tedavi veya tanı koymadığı hatırlatılıyor.

Ruh Sağlığı Alanında Yapay Zekânın Yükselişi

YZ sadece sohbet etmekle kalmıyor; aynı zamanda sağlık verileriyle entegre edilebiliyor (ses, yazma hızı, mobil sensör verileri gibi). Bu, doktorlara yardımcı olabilecek teknikler için potansiyel sunsa da, aynı zamanda büyük veri ve mahremiyet risklerini artırıyor.

Ayrıca teknoloji devlerinin (GAFAM gibi) bu alana ilgi göstermesi, mesleki sınırların bulanıklaşmasına neden oluyor.

Bilimsel ve Klinik Toplumdan Uyarılar

- Bazı gençlerde intihara varan kötü deneyimler rapor edildi — bu tarz olaylar hem klinik hem hukuki incelemeye tabi oldu.

- Chatbot’lar genellikle kullanıcının söylediklerine uygun şekilde yanıt verirler (sycophancy); bu da duygu durum bozukluğu veya delilik gibi durumlarda yanlış pekiştirmeye yol açabilir.

- Mühendislik odaklı algoritmalar, insan terapistlerin sahip olduğu empati ve klinik değerlendirme yeteneğinden yoksundur. Bu yüzden ciddi ruhsal kriz durumlarını tanılayamaz veya uygun müdahaleyi yapamazlar.

- Veri gizliliği ciddi bir endişe — kullanıcıların verdiği kişisel ve duygusal bilgiler, klinik sır kapsamında korunmaz ve şirket politikalarına göre işlenebilir.

Ayrıca Amerikan Psikolojik Derneği ve benzeri kuruluşlar, yapay zekâ ürünlerinin yalnızca otomatik destek araçları olduğunu ve kendi başına ruh sağlığı krizi yönetiminde kullanılmaması gerektiğini belirtiyorlar.

Parçalanan Klinik Uygulama ile Dijital Destek Arasındaki Çatışma

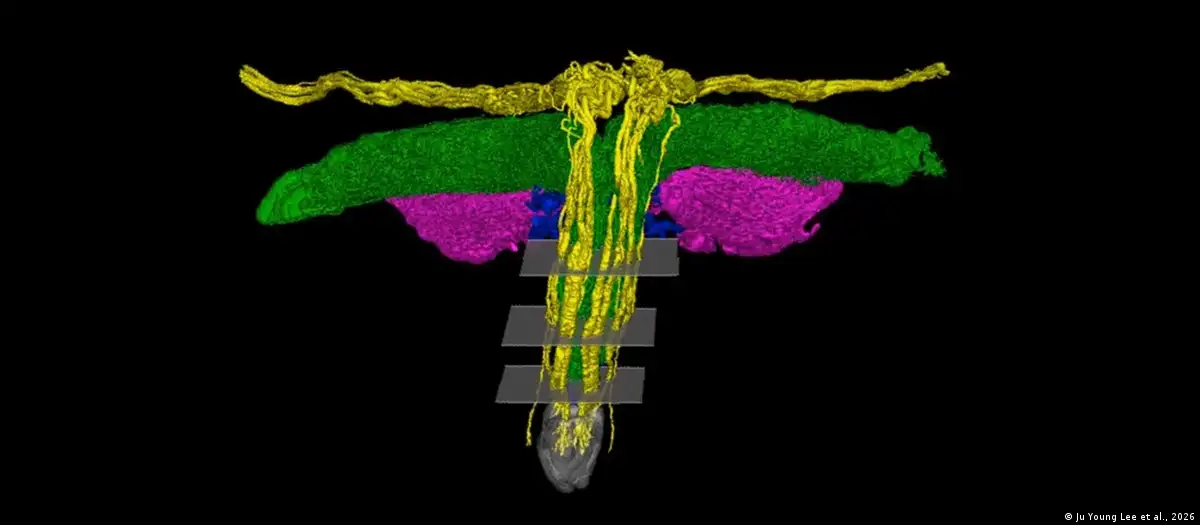

Psikiyatri alanında YZ’nin olumlu kullanım potansiyelini de aktarabilecektir. Örneğin; Veri analizi, nörolojik ölçümler ve yeni tür dijital biyo-belirteçler aracılığıyla doktorlara yardımcı olabilecektir.

Gelecekte AI, insan terapistlerinin karar süreçlerini destekleyecek hipotez ve tanı önerileri sunabilecektir.

Buna karşın mevcut durumda bina edilen sistemler psiko-terapötik ilişkiyi, insan-insan etkileşimini ve klinik uzmanlığı tam olarak ikame edemiyor, bu da hatalı teşhis, yanlış yönlendirme ve kişiyi tehlikeye atma riskini artırmaktadır.

Sonuç: Fırsatlar ve Riskler Bir Arada

Yapay zekâ ve chatbot’ların psikiyatri ve ruh sağlığı alanında yükselen rolü ile ilgili hem umut hem de ciddi uyarı taşımaktadır:

- Potansiyel faydalar: Erişimi artırma, gençler için düşük maliyetli destek, doktorlara veri temelli ipuçları sağlama.

- Riskler: Yanıltıcı veya zararlı tavsiyeler, kriz yönetiminde yetersizlik, bağımlılık ve yanlış güven duygusu, veri gizliliği sorunları ve etik endişeler.

Bu nedenle uzmanlar, YZ’nin ruh sağlığı desteğinde sadece bir yardımcı araç olarak düşünülmesi gerektiğini; psikiyatri uygulamalarında insan etkileşiminin yerini almaması gerektiğini vurgulamaktadır.

Le Monde